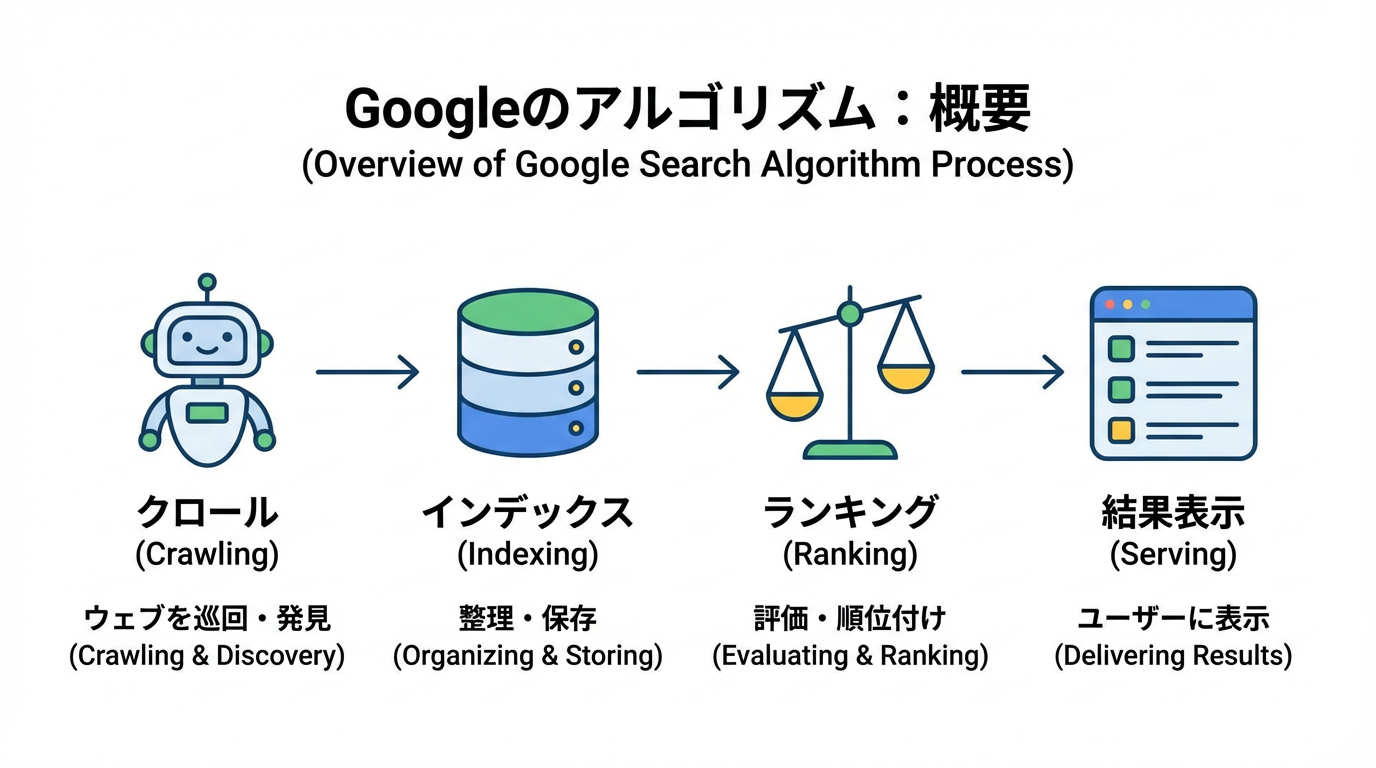

- Googleのアルゴリズムを「情報収集→整理→評価→表示」というプロセスで理解できます。

- クローリング・インデックス・ランキングの違いと、それぞれで起こりやすい問題を整理します。

- E-E-A-Tを含む主要ランキング要因を、検索意図・品質・信頼性・体験の4観点でチェックできます。

- コアアップデートやスパム対策など、順位変動時の原因切り分けと対応の順番が分かります。

- 技術SEO・コンテンツ・ガバナンスの観点から、今日から使える実務チェックリストを提供します。

Googleのアルゴリズムとは?まず押さえる定義と全体像

Googleのアルゴリズムは、世界中のWebページを収集し、整理し、検索クエリごとにランク付けするための多数の仕組みの総称です。 一言で「アルゴリズム」と呼ばれますが、実際には数百を超えるシグナルやシステムが組み合わさって検索体験を最適化しています。

ビジネスやメディア運営の観点では、「クローリング」「インデックス」「ランキング」の3段階と「検索結果画面での表示」を理解しておくことが重要です。 これらを正しく押さえることで、何が原因で検索流入が増えないのか、どこから改善すべきかを冷静に判断しやすくなります。

アルゴリズムは「検索体験の最適化ルールの集合」

「Googleのアルゴリズム」というと、単一の秘密のレシピのようにイメージされがちです。 しかし実際には、関連性・品質・信頼性・ユーザー体験などを評価する複数のシステムやルールの集合体だと考えた方が実態に近いです。

Googleは公式ドキュメントや検索セントラルブログで、ランキングシステムやスパム対策システムなどについて継続的に情報を公開しています。 これらはすべて、最終的に「検索者にとって最も役立つ情報を、できるだけ素早く・安全に届ける」という目的に沿って設計されています。

そのため、アルゴリズムを深読みして裏技を探すよりも、「ユーザーにとって良い結果とは何か」を起点に考えた方が、中長期的には安定した成果につながりやすいです。

要約ボックス:結局、何を意識すべき?(3〜5点)

本記事全体の要点を、すぐに実務で使えるように5つの観点に整理しておきます。 どの施策を検討するときも、次の5つをチェックする癖を付けると、アルゴリズム変更が起きてもブレにくいSEOになります。

- 検索意図:クエリごとに、ユーザーが「知りたい・成し遂げたいこと」を明文化できているか。

- コンテンツ品質:一次情報・具体例・最新性・わかりやすさの面で、実際に役に立つか。

- 体験(UX):ページ速度、モバイル、導線設計など、ストレスなく目的を達成できるか。

- 信頼性(E-E-A-T):誰がどんな経験や根拠にもとづいて書いているかが伝わるか。

- 技術基盤:クローリング、インデックス、構造化データなど、技術的な足かせがないか。

これら5つはどれか一つだけではなく、総合的なバランスで評価される点が重要です。 逆に言えば、どれか一つが大きく欠けていると、他をどれだけ強化しても検索結果で評価されにくくなります。

「アルゴリズム変更=順位が上がる/下がる」ではない理由

アルゴリズムの変更やコアアップデートがあると、「アップデートで順位が下がった」と表現されることがあります。 しかし本質的には、評価の物差しが変わり、自社と競合の相対的な位置づけが変化したと捉えるのが適切です。

たとえば、自社サイトは以前とほぼ同じ内容でも、他社がよりユーザーに役立つ情報を追加したり、技術的な改善を行った場合、相対的に評価が下がることがあります。 また、Googleが特定ジャンルやスパム対策を強化した結果、評価されやすいシグナルの重み付けが変わることもあります。

そのため、順位変動があった際には「アルゴリズムのせい」と一括りにするのではなく、「自サイトの品質」「競合の動き」「技術的な問題」など、原因を丁寧に切り分けて考えることが重要です。

検索結果はどう決まる?クローリング〜インデックス〜ランキングの仕組み

検索結果の順位は、Googleがページをどのように見つけ、どのように保存し、どのように評価しているかという一連の流れの上に成り立っています。 各工程での仕組みと注意点を理解しておくと、インデックスされない・順位が付かないといった問題の原因を特定しやすくなります。

クローリング:発見されないページは評価対象になりにくい

クローリングとは、GooglebotなどのクローラーがWeb上のリンクを辿ってページを発見・取得するプロセスです。 どれだけ良いコンテンツを用意しても、クローラーに見つけてもらえなければ検索結果に出ることはありません。

具体的には、内部リンク構造、XMLサイトマップ、外部リンク、そしてrobots.txtやmeta robotsタグの設定がクローリングに大きく影響します。 重要なページがトップページやカテゴリページから数クリック以内でたどれるか、noindexやdisallowで誤ってブロックしていないかなどを定期的に確認することが大切です。

クローリングの状況は、Google Search Consoleの「ページのインデックス」や「クロール統計情報」レポートから把握できます。 クロールエラーや検出されていないURLが多い場合は、内部リンクやサイトマップの見直し、リダイレクトの整理など技術的な改善が必要です。

インデックス:登録される情報と、されない典型パターン

インデックスとは、クローラーが取得したページを検索用データベースに保存し、クエリに応じて参照できる状態にするプロセスです。 クローリングされたからといって必ずしもインデックスされるわけではなく、重複・薄い内容・技術的設定などにより除外されることもあります。

代表的なインデックス除外の要因としては、noindexタグの設定、canonicalタグの不整合、コンテンツの重複や極端に薄いページ、404やソフト404などのエラー、そして品質や需要が低いと判断されるケースなどがあります。 これらはSearch Consoleの「ページ」レポートで、除外理由とともに確認できます。

もし重要なページがインデックスされていない場合は、まず技術的な設定を確認し、その上で内容が十分に価値を提供しているかを見直します。 特に、大量に似たようなページを生成しているサイトでは、統合・削除・noindexの使い分けが重要になります。

ランキング:クエリごとに「関連性」と「有用性」を評価する

ランキングとは、インデックスされた多数のページの中から、特定のクエリに対してどのページをどの順番で表示するかを決める工程です。 基本的には、検索意図との関連性と、コンテンツの有用性・信頼性・体験の良さが総合的に評価されます。

Googleはランキング要因を「数百以上のシグナル」と説明していますが、その中核にあるのが検索意図の理解とコンテンツの品質です。 これに加えて、ページの読み込み速度やモバイル対応、内部リンク構造、構造化データなど、技術的な要素も評価に影響を与えます。

重要なのは、個々のシグナルを単体で最適化するのではなく、「このクエリに対して、ユーザーが満足するゴールまでスムーズに到達できるか」という視点で全体設計を行うことです。 その上で、Search Consoleや分析ツールを使って、クエリごとの表示回数・クリック率・滞在行動を確認し、改善サイクルを回していきます。

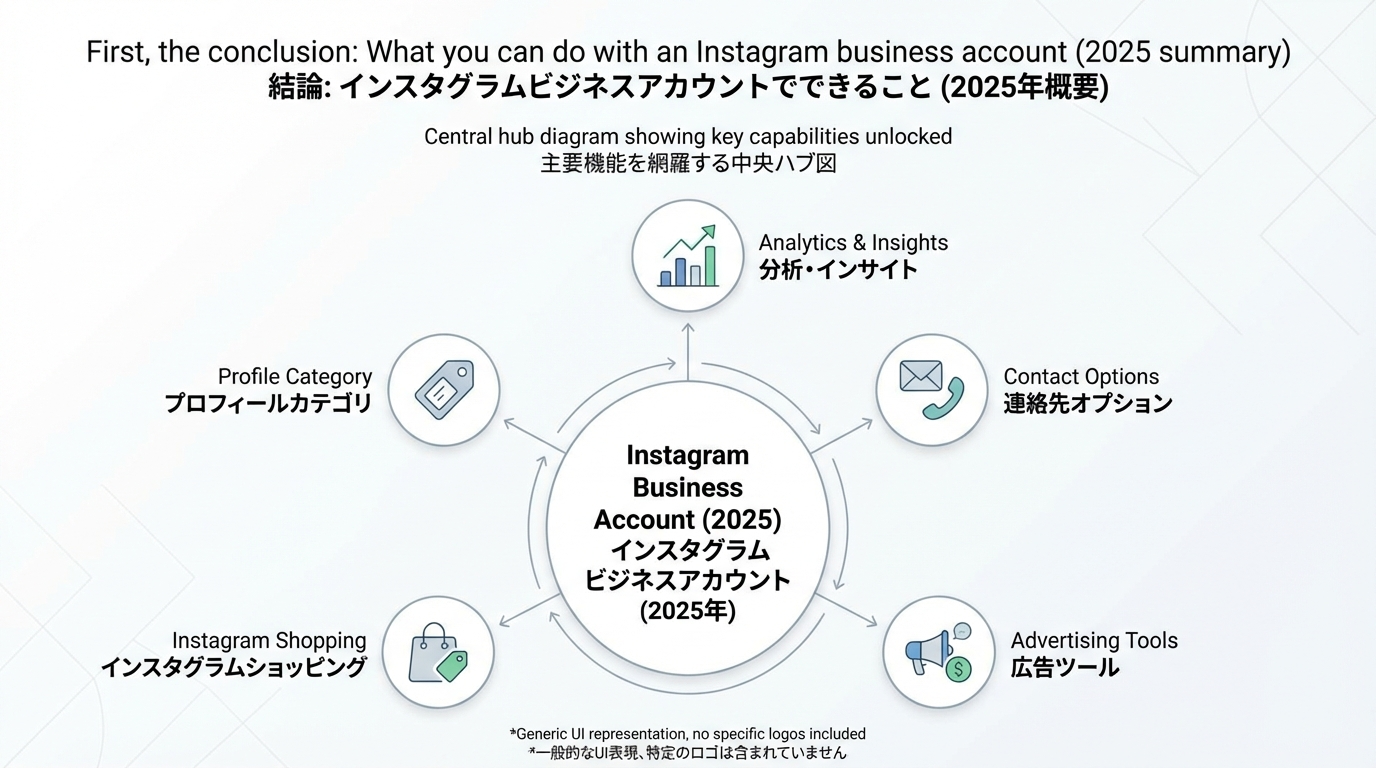

主要ランキング要因の整理:何が評価されやすいのか(E-E-A-T含む)

Googleのアルゴリズムは多面的ですが、実務的には「検索意図」「コンテンツ品質」「信頼性(E-E-A-T)」「ユーザー体験」の4つの軸で考えると整理しやすくなります。 これらを網羅的にチェックすることで、どの観点がボトルネックになっているかを把握できます。

検索意図(インテント)一致:同じキーワードでも答えが違う

同じキーワードでも、ユーザーが求めているものは「情報収集」「比較検討」「購入」「特定サイトへの移動」などさまざまです。 たとえば「Shopify 手数料」というクエリであれば、料金の一覧表が欲しいのか、他サービスとの比較が知りたいのかによって最適なページ構成が変わります。

実務では、狙うクエリごとに「検索意図シート」を作成し、「情報(Know)」「行動(Do)」「移動(Go)」「購入(Buy)」といった分類を行うのがおすすめです。 そのうえで、見出し構成・図解・CTA(問い合わせや資料請求など)を、意図に沿うように設計していきます。

検索結果の1ページ目に並んでいる上位サイトの傾向を分析することも有効です。 上位の多くが比較記事であれば比較軸を整理し、レビューが多ければ実体験や事例を厚くするなど、「ユーザーが求めている答えの型」に合わせてページを最適化していきます。

コンテンツ品質:網羅性より「役に立つ具体性」へ

かつては「網羅性=文字数の多さ」と捉えられることもありましたが、現在のGoogleは「ユーザーの課題解決にどれだけ具体的に役立ったか」を重視しています。 つまり、一次情報・実体験・具体例・手順・注意点がしっかり盛り込まれているかが重要です。

公式ドキュメントや一次情報へのリンクを適切に貼り、必要に応じて引用を行うことも品質向上につながります。 例えば、Googleの検索に関するガイドラインについて言及する際には、Google検索セントラルの公式ドキュメント[1]の内容を参照するとよいでしょう。

また、更新頻度も重要です。 法改正や料金変更が頻繁に起こるジャンルで古い情報が残っていると、ユーザーに誤解を与えるだけでなく、サイト全体の信頼性低下にもつながりかねません。 定期的なリライト計画や、古い記事の統合・削除を行い、情報の鮮度を保つことが求められます。

E-E-A-Tと信頼性:誰が、何を根拠に語るか

E-E-A-Tとは、Experience(経験)、Expertise(専門性)、Authoritativeness(権威性)、Trust(信頼性)の頭文字をとった概念で、Googleの検索品質評価ガイドラインで重視されています。 特にお金や健康などのYMYL領域では、誰が・どんな経験や資格をもとに情報を発信しているかが評価に影響しやすいとされています。

実務的には、著者プロフィールの充実、監修者の明記、運営会社情報や連絡先の掲載、プライバシーポリシーや免責事項の整備などが基本です。 また、一次情報としての実績データや事例、第三者からの評価(レビュー・取材・掲載実績など)も、権威性や信頼性を補強する材料になります。

さらに、引用や参考文献の出典を明示し、誤解を招く表現や誇大広告を避けることも重要です。 こうした取り組みは、検索評価だけでなく、ユーザーとの長期的な信頼関係構築にも直結します。

アップデートとペナルティの考え方:変動時の原因切り分けとリスク管理

検索順位の大きな変動が起きたとき、多くの担当者が「アルゴリズムアップデートか、ペナルティか」を気にします。 実際には、コアアップデート・スパム対策・手動対策・技術的問題など、複数の可能性があり、それぞれ確認方法と対処方針が異なります。

コアアップデート:サイト全体評価の見直しが起きやすい

コアアップデートは、Googleが検索全体の品質を高めるために行う大規模なアルゴリズムの調整です。 特定のテクニックを狙い撃ちにするというよりも、より有用で信頼できる情報を上位に表示するための「再評価」と説明されています。

コアアップデートによる影響は、特定のページではなくサイト全体やテーマ単位で現れることが多く、短期的な小手先の修正ではリカバリしにくいのが特徴です。 Googleは、コンテンツ品質に関する一連の自問リストを公開しており、これらを参考にページを見直すことが推奨されています[2]。

実務では、影響を受けたクエリやページ群を特定し、検索意図とのずれや情報の古さ、E-E-A-Tの不足、UXの問題などを洗い出したうえで、中長期的な改善計画を立てることが重要です。 一度のアップデートで結果が戻らなくても、継続的な品質向上に取り組むことで、次回以降の評価に反映される可能性があります。

スパム/低品質対策:やってはいけない施策の例

Googleは、検索スパムや低品質なコンテンツを排除するために、スパムアップデートやマニュアルアクション(手動対策)を行っています。 特に避けるべきなのは、隠しテキスト・キーワード乱用・自動生成コンテンツの量産・過剰なリンク購入などの行為です。

これらはGoogle検索のスパムポリシーで明確に禁止されており、違反すると自動的な評価低下に加えて、Search Console経由で手動対策の通知が来ることもあります。 通知が来た場合は、問題箇所の修正と再審査リクエストが必要になり、ビジネスの継続性に大きなリスクとなります。

短期的な順位上昇だけを狙ったテクニックに頼るのではなく、ユーザー価値とガイドライン順守を前提にした施策設計を行うことで、アルゴリズム更新にも強い健全なサイト運営が可能になります。

順位が落ちたときの診断手順(データ→仮説→改善)

検索順位やトラフィックが落ちたときは、感覚ではなくデータにもとづいて原因を切り分けることが大切です。 おすすめなのは、「計測 → セグメント(切り分け) → 改善 → 検証」という4ステップのフローを決めておくことです。

まずは、計測タグや期間設定、季節性の影響などを確認し、データの前提に問題がないかをチェックします。 次にSearch Consoleで、クエリ別・ページ別・デバイス別に表示回数・クリック数・掲載順位の変化を確認し、どの領域で変動が大きいかを特定します。

そのうえで、技術的な問題(noindexやrobots、エラー、速度低下など)がないかを優先的に確認し、問題なければ検索意図やコンテンツ品質、E-E-A-T、内部リンク構造などを見直します。 改善後は、同じ指標を使って数週間〜数カ月単位で推移を追い、施策の効果を検証しながらPDCAサイクルを回すことが重要です。

今日からできる実装・運用チェックリスト(技術SEO×コンテンツ×ガバナンス)

アルゴリズムの理解を、実際の施策や運用フローに落とし込むことが重要です。 ここでは、「技術SEO」「コンテンツ運用」「E-E-A-Tガバナンス」の3つの観点から、今日から使えるチェックリストの例を紹介します。

技術SEO:表示速度・モバイル・構造化で損失を減らす

技術SEOは、ユーザー体験とクローラーの理解を支えるインフラのような存在です。 たとえ良いコンテンツがあっても、ページ速度が極端に遅い・モバイル表示が崩れている・インデックスされていないといった問題があると、本来の評価を得られません。

具体的なチェック項目としては、Core Web Vitalsの指標(LCP・FID/INP・CLS)の改善、モバイルフレンドリーなデザイン、HTTPS対応、論理的な内部リンク構造、重複URLの正規化(canonical設定)などが挙げられます。 また、構造化データを用いて商品・記事・FAQなどの情報をマークアップすることで、リッチリザルトとして検索結果に表示される可能性も高まります。

これらは一度対応して終わりではなく、サイト改修やページ追加のたびに影響が出る可能性があります。 そのため、開発フローにSEOチェックを組み込んだり、定期的にGoogle Search ConsoleやPageSpeed Insightsで状態を確認する仕組みを作ることが重要です。

コンテンツ運用:更新計画と品質基準を先に決める

コンテンツマーケティングでは、「作りっぱなし」ではなく、計画的な更新と品質管理が成果を左右します。 まずは、狙うクエリやテーマを一覧化し、検索意図・ペルソナ・記事のゴールを記載した「コンテンツブリーフ」を作成することが有効です。

さらに、編集ガイドラインとして「見出し構成のルール」「引用・出典表記の方法」「図表やスクリーンショットの扱い」「禁止表現」などを定めておくと、ライターや社内メンバーが増えても品質を一定に保ちやすくなります。 こうしたガイドラインは、E-E-A-Tやブランドトーンを守るための重要なドキュメントにもなります。

また、公開後の更新計画もあらかじめ決めておくとよいでしょう。 アクセスデータや検索クエリの変化を見ながら、古くなった情報のアップデート、類似記事の統合、成果が出ていない記事の方向性見直しなどを行い、サイト全体としての価値を高めていきます。

E-E-A-Tのガバナンス:著者・監修・引用の整備

E-E-A-Tを一時的な対応で高めることは難しく、組織としてのガバナンス体制が問われます。 具体的には、「著者」「編集者」「監修者(必要に応じて専門家)」の役割を明確にし、それぞれがどのような観点でチェックするかを決めておくことが重要です。

たとえば、著者は一次情報の収集と分かりやすい構成づくり、編集者は事実確認と表現の妥当性、監修者は専門的な正確性を確認するといった分担が考えられます。 併せて、引用ルールや利益相反の開示ルールを定め、読者が情報の背景を判断できる状態を作ることが重要です。

こうした体制は、検索評価だけでなく、法規制や広告審査への対応、ブランド価値の保護にもつながります。 特にECサイトやメディアを運営する企業では、社内ガイドラインやチェックリストを文書化し、定期的に見直すことをおすすめします。

よくある質問(FAQ)

Googleのアルゴリズムとは何ですか?

Googleのアルゴリズムとは、検索者のクエリに対して最も役立つ結果を返すために設計された、クローリング・インデックス・ランキングなど多数の仕組みやルールの総称です。 単一のルールではなく、多数のシステムが組み合わさって検索体験を最適化しています。

Google検索のランキング要因で一番重要なのは何ですか?

Googleは数百のシグナルを総合評価していると公表しているため、「一番重要な1つ」を断定することはできません。 ただし実務的には、検索意図との一致(関連性)と、内容の有用性・信頼性(E-E-A-T)が土台であり、その上で技術的な問題がないことが重要と考えられます。

コアアップデートが来たら何をすればいいですか?

まず、Googleが公式にアップデートを発表しているかを確認しつつ、Search Consoleや分析ツールで影響範囲(ページ群・クエリ・デバイス)を特定します。 そのうえで、意図不一致や情報の古さ、根拠不足、ユーザー体験の低下などの仮説を立て、コンテンツ品質と体験の底上げに取り組むことが推奨されます。

Googleのペナルティとアルゴリズム更新の違いは?

アルゴリズム更新は、評価方法の自動的な調整であり、検索全体の品質向上を目的としています。 一方、いわゆるペナルティと呼ばれる「手動対策」は、ガイドライン違反が疑われるサイトを人間が確認し、Search Consoleで通知が届くケースを指し、明確な違反とその対応方針が示される点が異なります。

インデックスされない原因は何が多いですか?

よくある原因として、noindex設定やrobots.txtによるブロック、canonicalタグの不整合、重複や薄いコンテンツ、クローラーがたどり着けないサイト構造、需要や品質が低いと判断されるケースなどがあります。 まずはSearch Consoleの「ページ」レポートで、除外理由のステータスを確認することが重要です。

検索順位が急に落ちたとき、最初に確認すべきことは?

まず、計測タグの不具合やトラッキング設定の変更がないか、シーズナリティやキャンペーン終了などビジネス要因がないかを確認します。 そのうえでSearch Consoleを開き、クエリ別・ページ別の表示回数・クリック数・掲載順位の推移と、インデックスや手動対策の通知、クロールエラーや速度低下といった技術的問題を優先的にチェックします。

まとめ:アルゴリズム理解を「継続改善の判断軸」に変える

Googleのアルゴリズムは、インターネット上の膨大なページを収集・整理し、検索意図に最も合う有用で信頼できる情報を順位付けするための仕組みです。 すべてを完全に把握することはできませんが、クローリング・インデックス・ランキングと主要ランキング要因の考え方を押さえることで、実務で迷いにくくなります。

順位変動が起きたときは、データにもとづいて原因を切り分け、コンテンツの品質やユーザー体験、技術SEO、E-E-A-Tといった観点から優先度を決めて改善していくことが大切です。 一時的な裏技を探すのではなく、ユーザーにとって役立つ情報と良質な体験を提供し続けることが、結果的にアルゴリズムにも評価される近道だといえます。

ECサイトやメディア運営、中小企業のオウンドメディアなど、ビジネスごとに最適な戦略や実装は異なります。 自社の現状と目標を踏まえながら、今回の内容を「検索流入の継続改善に向けた判断軸」として活用していただければ幸いです。

Share:

CTAとは?クリックされるCTAの書き方

ビジョンステートメントとは?